量子计算机算力“逆天”,但出错概率也高,所以一直“赖”在实验室。4月14日,知名科技企业英伟达在“世界量子日”发布全球首个量子AI模型Ising(伊辛),专门针对量子计算机易出错痛点,有望打造出实际可用的量子计算机。

==============================

量子计算容易“犯错”

不同于经典计算机以非此即彼的物理比特运行,量子计算机依靠的是拥有更多叠加状态的量子比特。

理论上讲,量子计算机能解决一些经典计算机“不可能完成”的任务。

但问题是,量子计算机特别容易“犯错”,而且还不像普通电脑只是偶尔出个小错误。4月20日,中国科学院计算技术研究所工程师刘延嘉在接受科普时报记者采访时,将量子比特比喻成会分心的小学生,它们极易被周围环境干扰而产生漂移。“哪怕是温度变化、电磁干扰,甚至宇宙射线等微弱干扰,都可能让计算结果跑偏。”

更麻烦的是,量子状态太脆弱,就像“薛定谔的猫”——不观察时处于叠加态,一旦被干扰就会“坍缩”,出错也就成了家常便饭。

当前最好的量子处理器,大约每运行1000次就出错一次,而“实用量子计算”的要求,是要将错误率降到万亿分之一级别。现实与理想间的差距高达10亿倍,这样的量子计算机该如何实现规模化应用?谁又放心用呢?

传统方法难以“医治”

让量子计算机真正能用起来,就需要对量子比特进行校准和纠错,实验室里其实也都有应对之法。

校准,是为了让易漂移的量子比特保持最佳状态,就像给量子计算机做“体检”和“调理”。

只不过,传统的校准方法需要物理学家手动完成:调微波脉冲、调激光功率、调磁场……一遍遍试,通常要好几天,而且每次计算前都得重来,麻烦又低效。

纠错,则是给量子计算机穿上“防护服”。传统方法的核心理念是,用多个对外界干扰特别敏感的物理量子比特,编码成为一个非常可靠的“逻辑量子比特”用于运算。

量子力学却告诉我们,实验者不可能在不引起“坍缩”的情况下测量量子叠加态。这意味着,科研人员必须“蒙着眼睛”找错误,就像在黑暗中修手表,难度可想而知。

如今的量子芯片越来越复杂,一旦量子比特的数量从几百个跨越到成千上万个,这种依靠人工干预和调整参数的方法,根本支撑不起规模化的应用。

商业应用“曙光”初现

英伟达的Ising模型,其实就像给量子计算装上了一套成熟的AI智能大脑。它把视觉语言模型、3D卷积神经网络这些前沿AI技术整合在一起,让原本需要精细调试的量子比特,能实时、自动地完成精准校准。

目前官方给出的校准时间,从之前的几天缩短到几小时,纠错速度提升2.5倍,精度也提高3倍。

以至于,英伟达创始人黄仁勋说了一句“大话”——有了Ising,AI将成为量子计算机的操作系统。

“AI并非为提升算力而来,也不会替代量子计算,而是会成为其‘最佳搭档’。”刘延嘉认为,AI与量子计算的深度融合,有望补齐量子计算机商用道路上那块最明显的“短板”。

当然,推动量子计算机商业化的可不只有AI大模型。

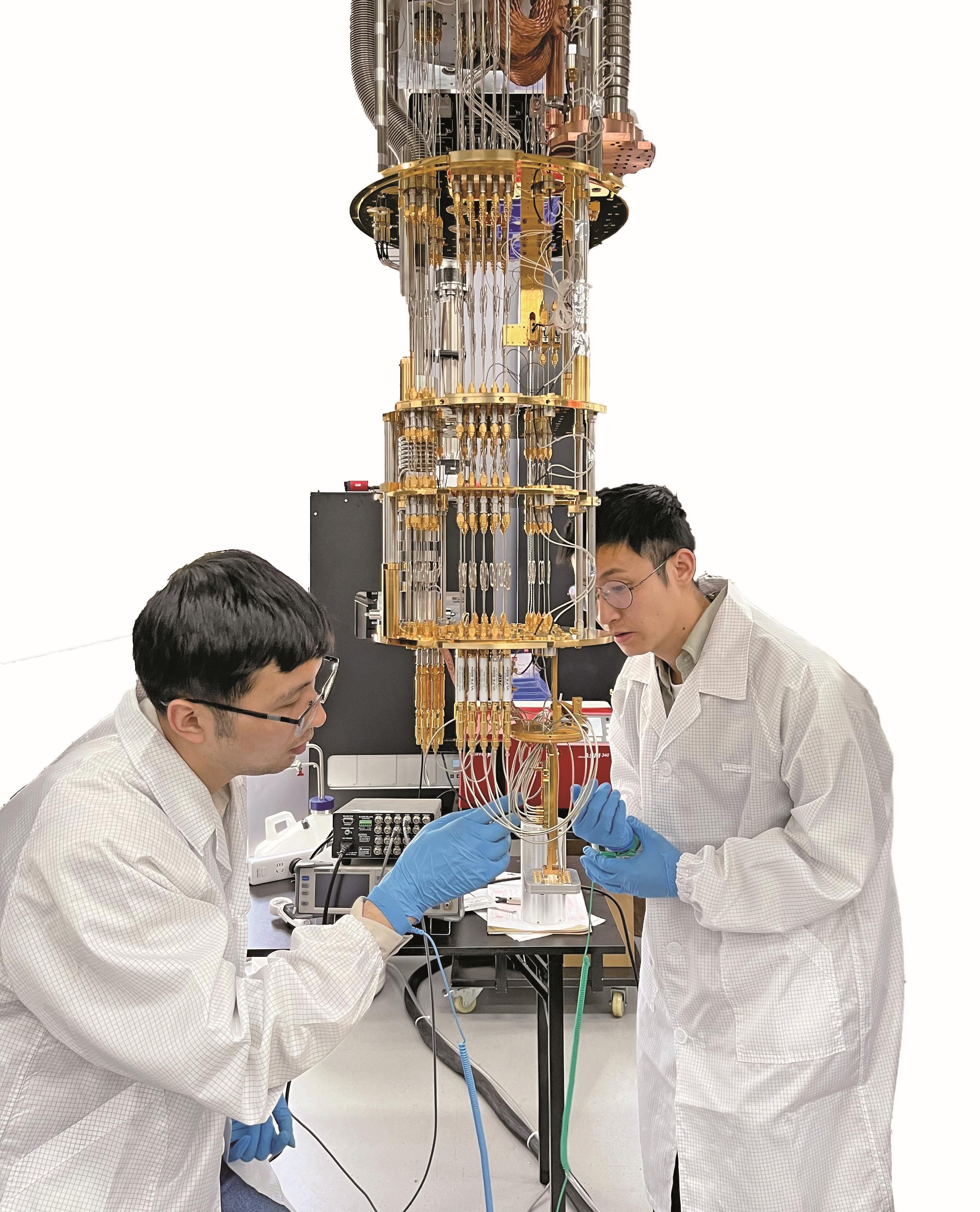

目前,我国已构建起从量子芯片、测控系统到操作系统的全栈自主产业链,“本源司南”成为全球首个可开放下载的量子操作系统;4月3日,中国科学技术大学研发出666位超导量子计算芯片,量子比特保真度达99.92%,运算速度较传统超算提升1.2亿倍……

在推动量子计算机商用赛道上,全球量子产业界都在持续发力,为的就是让量子计算机尽快走出实验室。

==============================

延伸阅读

神奇的量子比特

量子计算的超能力,源于神奇的量子比特。

我们平时用的电脑,以物理比特处理信息——要么是“开”(代表1),要么是“关”(代表0)。

量子计算机用的是拥有“叠加态”的量子比特。它并不像物理比特那样非0即1,而是像一枚快速旋转的硬币——在落地之前,它既是正面又是反面,这种状态叫作“叠加态”。

也就是说,一个量子比特可以同时表示0和1,两个量子比特就能同时表示00、01、10、11四种状态。

量子比特的这种超能力,让量子计算机在处理某些问题时特别强大。比如破解密码,传统计算机就像一个人站在迷宫入口,只能一条路一条路地试;量子计算机却能同时派出很多个量子比特,每条路都“走”,瞬间就能找到出口。

要知道,9年前IBM构建的50量子比特的量子计算机原理样机,仅一步就能进行2的50次方运算,相当于经典计算机一千万亿次计算。如今,我国已经成功研制出666位超导量子计算芯片。

量子计算机带来的指数级算力增长,让其在药物研发、材料设计、金融分析等领域有着巨大的应用潜力。